Cyberwojna przypadkowa to scenariusz, który jeszcze niedawno wydawał się wyłącznie filmową fikcją. Dziś coraz częściej pojawia się w analizach dotyczących bezpieczeństwa systemów wojskowych cyber oraz infrastruktury krytycznej. Wraz z rozwojem automatyzacji, integracji systemów i wykorzystania AI, pytanie jak powstaje cyberkonflikt przestaje być teoretyczne, a zaczyna mieć bardzo praktyczny wymiar.

W 1983 roku na ekrany kin trafił WarGames, który dla wielu był pierwszym zetknięciem z tematyką cyberbezpieczeństwa i ryzyka związanego z nieautoryzowanym dostępem do systemów wojskowych. Główny bohater, David Lightman, przypadkowo uzyskuje dostęp do superkomputera WOPR zarządzającego arsenałem nuklearnym. Uruchamia symulację globalnej wojny termonuklearnej, która niemal prowadzi do realnego konfliktu.

Od fikcji do realnego ryzyka OT i ICS

Z perspektywy dzisiejszych realiów OT i ICS ten scenariusz nie jest już tylko narracją filmową. To model ryzyka, który można przełożyć na rzeczywiste środowiska operacyjne. ICS cybersecurity zagrożenia infrastruktury krytycznej obejmują dziś nie tylko bezpośrednie ataki, ale także błędy, nieprawidłowe dane i niezamierzone działania użytkowników.

Cyberwojna przypadkowa w takim ujęciu nie wynika z intencji, lecz z interakcji systemów, ludzi i automatyki. W środowiskach, gdzie decyzje są podejmowane na podstawie danych z systemów SCADA, a reakcje mogą być częściowo zautomatyzowane, nawet niewielkie odchylenie może zostać zinterpretowane jako incydent o charakterze wrogim.

To właśnie tutaj pojawia się realne OT ICS ryzyko eskalacji konfliktu. Nie chodzi o pojedynczy atak, lecz o łańcuch zdarzeń, w którym:

- system wykrywa anomalię

- dane są błędnie interpretowane

- reakcja jest podejmowana automatycznie lub pod presją czasu

Granica między incydentem technicznym a konfliktem zaczyna się zacierać. I dokładnie to przewidział WarGames, tylko w znacznie prostszej, analogowej rzeczywistości.

Architektura systemów krytycznych w cyberwojnie przypadkowej

W kontekście cyberwojny przypadkowej architektura systemów wojskowych ma kluczowe znaczenie dla zrozumienia, jak powstaje cyberkonflikt i gdzie pojawia się ryzyko jego niezamierzonej eskalacji. Współczesne środowiska operacyjne nie są pojedynczymi systemami, lecz złożonym ekosystemem powiązanych komponentów IT i OT.

Systemy odpowiedzialne za obronę strategiczną, takie jak wczesne ostrzeganie, kierowanie ogniem czy struktury C4ISR, funkcjonują w ramach silnie kontrolowanych i często izolowanych środowisk. Ich zadaniem jest przetwarzanie danych w czasie zbliżonym do rzeczywistego i wspieranie decyzji o wysokiej krytyczności operacyjnej.

Gdzie pojawia się realne ryzyko eskalacji

Z perspektywy OT i ICS oznacza to środowisko, w którym:

- dane telemetryczne mają bezpośredni wpływ na decyzje

- integracja systemów zwiększa powierzchnię ataku

- czas reakcji jest ograniczony przez presję operacyjną

To właśnie tutaj pojawia się realne OT ICS ryzyko eskalacji konfliktu. System nie musi zostać przejęty, aby stał się elementem incydentu. Wystarczy, że dane, które przetwarza, zostaną zaburzone lub błędnie zinterpretowane.

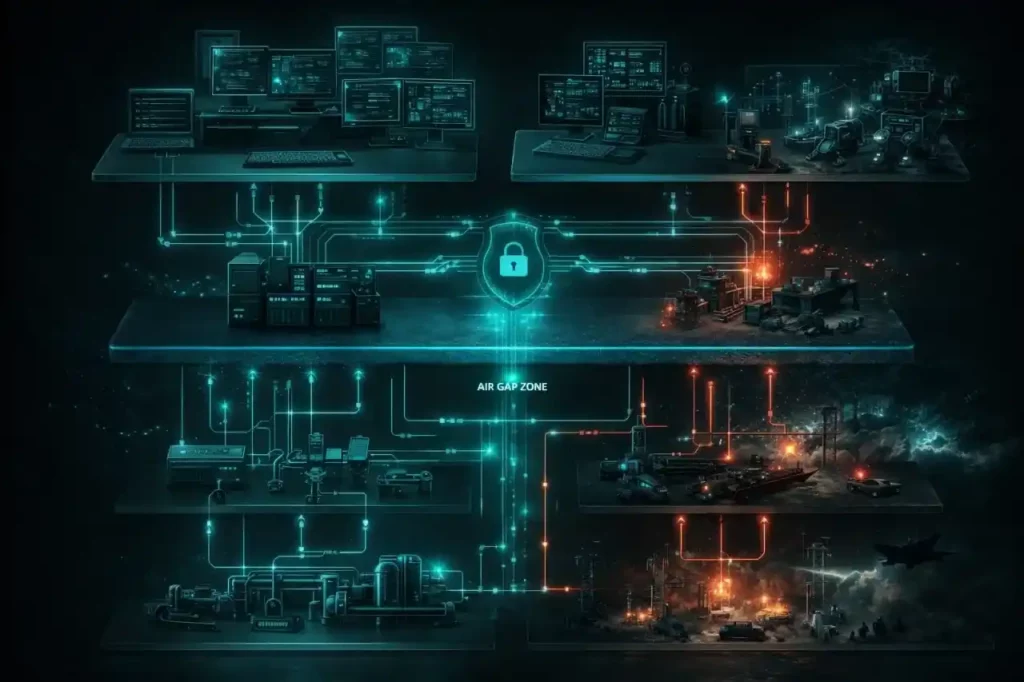

Mimo że wiele systemów nadal korzysta z architektury odizolowanej od Internetu, tzw. air gap, ICS cybersecurity zagrożenia infrastruktury krytycznej pokazują, że separacja fizyczna nie jest wystarczającym mechanizmem ochrony. Przykład Stuxnet jednoznacznie udowodnił, że nawet środowiska odcięte od sieci publicznych mogą zostać skompromitowane.

W tym przypadku wektor ataku nie opierał się na zdalnym dostępie, lecz na wykorzystaniu nośników fizycznych oraz urządzeń mających dostęp do obu stref. To pokazuje, że bezpieczeństwo systemów wojskowych cyber nie może opierać się wyłącznie na izolacji, ale musi uwzględniać pełen łańcuch interakcji między systemami, ludźmi i procesem operacyjnym.

W praktyce oznacza to odejście od myślenia w kategoriach zamkniętego systemu na rzecz modelu, w którym każdy punkt integracji staje się potencjalnym źródłem incydentu. W takim środowisku nawet niewielkie odstępstwo od normy może uruchomić sekwencję zdarzeń prowadzącą do eskalacji.

Czy przypadek może wywołać cyberwojnę w OT i ICS

W kontekście cyberwojny przypadkowej pytanie o rolę pojedynczego użytkownika, nawet przypadkowego, przestaje być hipotetyczne. Jak powstaje cyberkonflikt w praktyce? Często nie zaczyna się od zaawansowanego ataku państwowego, lecz od błędu, braku kontroli lub nieświadomego działania w systemie o wysokiej krytyczności.

Scenariusz znany z WarGames, w którym młody użytkownik uzyskuje dostęp do systemu wojskowego, wydaje się uproszczony, ale jego fundament pozostaje aktualny. W środowiskach OT i ICS nie chodzi o to, kto inicjuje zdarzenie, lecz jakie są jego konsekwencje w systemie zależnym od danych i automatyki.

Błąd, który uruchamia łańcuch zdarzeń

W rzeczywistości wiele incydentów nie wynika z zaawansowanych technik ofensywnych, lecz z podstawowych problemów architektonicznych. ICS cybersecurity zagrożenia infrastruktury krytycznej często obejmują sytuacje, w których:

- brak segmentacji umożliwia przemieszczanie się między strefami

- niewłaściwa konfiguracja otwiera dostęp do systemów krytycznych

- kontrola dostępu nie uwzględnia realnych scenariuszy zagrożeń

Dobrym przykładem jest incydent z 2008 roku związany z Agent.btz, który ujawnił słabości w środowisku amerykańskiego dowództwa United States Central Command. Złośliwe oprogramowanie zostało wprowadzone do sieci przez nośnik fizyczny i rozprzestrzeniło się w systemach wojskowych.

Nie był to atak oparty na skomplikowanej eksploitacji. Kluczowym czynnikiem był brak kontroli nad wektorami wejścia oraz niedostateczna segmentacja środowiska.

Od incydentu do operacji wojskowej

Efektem incydentu było uruchomienie operacji Operation Buckshot Yankee, która stała się jednym z pierwszych dużych działań cyberobronnych na poziomie państwowym. Pokazała ona, że nawet relatywnie prosty incydent może mieć strategiczne konsekwencje.

Z perspektywy OT ICS ryzyko eskalacji konfliktu polega na tym, że system nie rozróżnia intencji. Reaguje na dane i zdarzenia. Jeśli te zostaną zaburzone, reakcja może być adekwatna do błędnej interpretacji, a nie do rzeczywistej sytuacji.

W praktyce oznacza to, że cyberwojna przypadkowa nie wymaga zaawansowanego przeciwnika. Wystarczy podatność, błąd lub niekontrolowany punkt dostępu, aby uruchomić sekwencję zdarzeń o skali znacznie większej niż pierwotny incydent.

Cyberwojna jako domena operacyjna w praktyce OT i ICS

W kontekście cyberwojny przypadkowej kluczowe jest zrozumienie, że cyberprzestrzeń nie jest już jedynie środowiskiem technologicznym, ale pełnoprawną domeną operacyjną. Organizacje takie jak NATO oraz wiele państw formalnie uznały ją za równorzędną wobec lądu, morza, powietrza i przestrzeni kosmicznej.

To oznacza fundamentalną zmianę w interpretacji zdarzeń. Jak powstaje cyberkonflikt w takim modelu? Nie zawsze poprzez intencjonalny atak. W wielu przypadkach wystarczy aktywność, która w innym kontekście byłaby uznana za technicznie neutralną.

Granica między incydentem a agresją

W środowiskach o wysokim napięciu geopolitycznym nawet pozornie nieszkodliwe działania, takie jak skanowanie portów, testowanie dostępności usług czy analiza infrastruktury, mogą zostać uznane za przygotowanie do operacji ofensywnej.

Z perspektywy ICS cybersecurity zagrożenia infrastruktury krytycznej oznacza to, że:

- incydent techniczny może zostać zinterpretowany jako działanie wrogie

- brak pełnej atrybucji zwiększa ryzyko błędnej decyzji

- czas reakcji skraca przestrzeń na analizę kontekstu

W takim środowisku OT ICS ryzyko eskalacji konfliktu rośnie nie przez sam atak, ale przez sposób jego interpretacji.

Automatyzacja decyzji i ryzyko błędu

Dodatkowym czynnikiem jest rosnąca rola automatyzacji i sztucznej inteligencji w systemach detekcji i reakcji. Nowoczesne środowiska wykorzystują algorytmy do analizy ogromnych wolumenów danych, identyfikacji anomalii i sugerowania działań obronnych.

Problem pojawia się w momencie, gdy system operuje na niepełnych lub zmanipulowanych danych. Ataki typu data poisoning, manipulacja telemetrią czy zakłócenia komunikacji mogą prowadzić do błędnych wniosków.

W środowisku OT nie jest to tylko problem analityczny. Decyzje podejmowane na podstawie tych danych mogą wpływać bezpośrednio na proces fizyczny, bezpieczeństwo operatorów oraz stabilność infrastruktury.

Cyberwojna przypadkowa w takim ujęciu nie jest efektem jednego zdarzenia, lecz wynikiem interakcji między automatyzacją, presją czasu i ograniczoną możliwością weryfikacji danych. W praktyce oznacza to, że system może zareagować poprawnie z punktu widzenia logiki, ale błędnie w odniesieniu do rzeczywistego kontekstu operacyjnego.

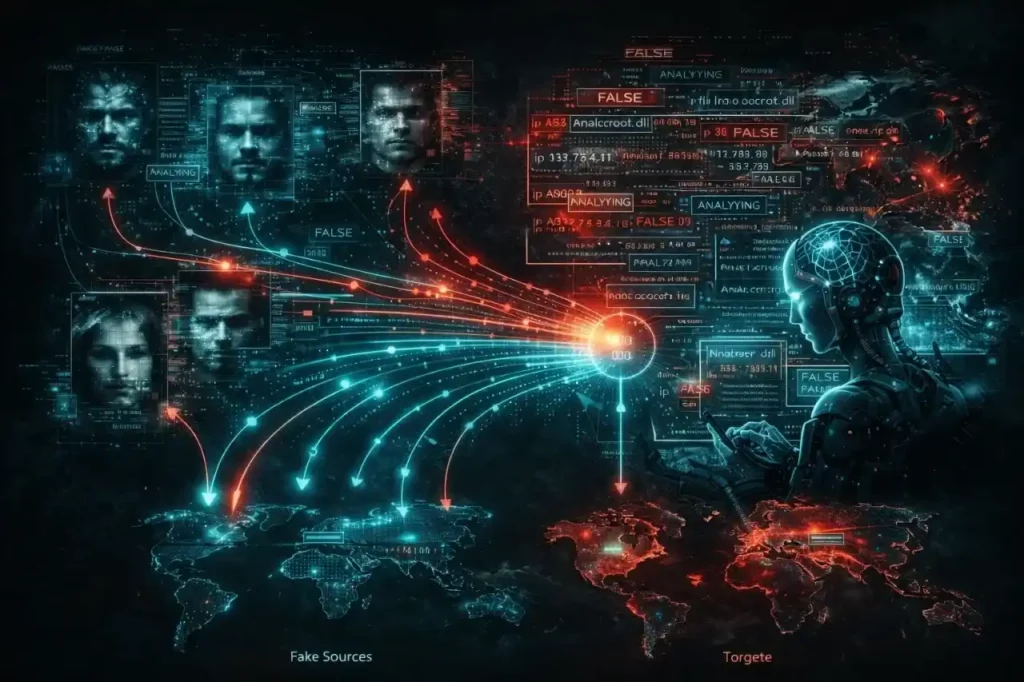

Fałszywe flagi, deepfake i cyberprowokacje w OT i ICS

W kontekście cyberwojny przypadkowej jednym z kluczowych ryzyk jest możliwość przeprowadzania operacji pod fałszywą flagą. Jak powstaje cyberkonflikt w takim scenariuszu? Nie przez sam atak, lecz przez błędną atrybucję jego źródła.

Techniki takie jak IP spoofing, manipulacja logami, proxy chaining czy deepfake audio i wideo pozwalają skutecznie ukryć lub zafałszować pochodzenie incydentu. W środowiskach OT i ICS, gdzie decyzje podejmowane są pod presją czasu, może to prowadzić do błędnych wniosków.

Z perspektywy ICS cybersecurity zagrożenia infrastruktury krytycznej oznacza to, że incydent wykonany przez niezależnego aktora może zostać uznany za działanie państwowe. W efekcie reakcja może być nieproporcjonalna do rzeczywistego zagrożenia.

To właśnie tutaj pojawia się realne OT ICS ryzyko eskalacji konfliktu. Błędna interpretacja zdarzenia, a nie sam atak, może uruchomić łańcuch prowadzący do konfliktu.

Cyberwojna przypadkowa bliżej niż myślisz

WarGames był przestrogą przed niekontrolowanym rozwojem technologii i jego konsekwencjami. Dziś, w realiach OT i ICS, cyberwojna przypadkowa nie jest już tylko scenariuszem filmowym, ale realnym ryzykiem wynikającym z automatyzacji, złożoności systemów i zależności od danych.

W środowisku, gdzie ICS cybersecurity zagrożenia infrastruktury krytycznej obejmują zarówno ataki, jak i błędy oraz zakłócenia danych, pytanie jak powstaje cyberkonflikt nabiera nowego znaczenia. To nie musi być świadome działanie przeciwnika. Wystarczy nieprawidłowa interpretacja zdarzenia w systemie o wysokiej krytyczności.

Ograniczenie tego ryzyka wymaga podejścia, które uwzględnia zarówno technologię, jak i kontekst operacyjny. Kluczowe znaczenie mają odporność architektury, kontrola dostępu, jakość danych oraz przygotowanie ludzi do podejmowania decyzji w warunkach niepewności.

OT ICS ryzyko eskalacji konfliktu pojawia się tam, gdzie system reaguje szybciej niż człowiek jest w stanie zrozumieć sytuację. Dlatego najważniejszym elementem bezpieczeństwa pozostaje nie technologia, lecz zdolność do właściwej interpretacji zdarzeń.

Granica między incydentem a konfliktem nie znika. Ona staje się coraz trudniejsza do zauważenia.

Najważniejsze wnioski

• Cyberwojna przypadkowa nie wymaga intencji – wystarczy błąd, anomalia lub błędna interpretacja danych.

• W środowiskach OT i ICS dane mają bezpośredni wpływ na decyzje operacyjne i fizyczne procesy.

• Automatyzacja i AI skracają czas reakcji, ale zwiększają ryzyko błędnej eskalacji.

• Air gap nie eliminuje zagrożeń – wektory fizyczne i integracyjne nadal istnieją.

• Granica między incydentem technicznym a konfliktem jest coraz trudniejsza do rozróżnienia.

• Największym ryzykiem nie jest atak, lecz sposób interpretacji zdarzenia.

FAQ

Czy cyberwojna przypadkowa jest realnym scenariuszem?

Tak. Współczesne środowiska OT i ICS są na tyle złożone i zautomatyzowane, że niezamierzone zdarzenia mogą prowadzić do eskalacji o charakterze strategicznym. Nie wymaga to intencjonalnego ataku, lecz kombinacji błędnych danych, reakcji systemów i presji operacyjnej.

Czym różni się cyberwojna przypadkowa od klasycznego cyberataku?

Klasyczny cyberatak zakłada intencję i celowe działanie przeciwnika. Cyberwojna przypadkowa wynika z błędów, nieprawidłowej interpretacji danych lub niekontrolowanych interakcji między systemami. Kluczowa różnica leży w braku intencji przy jednoczesnych realnych skutkach.

Czy systemy air gap nadal chronią przed tego typu ryzykiem?

Nie w pełni. Izolacja fizyczna ogranicza część wektorów ataku, ale nie eliminuje ryzyka. Przykłady takie jak Stuxnet pokazują, że nośniki fizyczne, łańcuch dostaw czy dostęp serwisowy mogą przełamać separację i wprowadzić zagrożenie do środowiska.

Jaką rolę odgrywa człowiek w scenariuszu cyberwojny przypadkowej?

Kluczową. Nawet w środowiskach wysokiej automatyzacji decyzje końcowe często należą do operatorów lub analityków. Błędy interpretacyjne, presja czasu oraz brak pełnego kontekstu mogą prowadzić do reakcji, które eskalują incydent zamiast go neutralizować.

Czy AI zwiększa czy zmniejsza ryzyko cyberwojny przypadkowej?

Jedno i drugie. AI zwiększa zdolność wykrywania anomalii i automatyzacji reakcji, ale jednocześnie wprowadza nowe ryzyka, takie jak data poisoning czy błędna klasyfikacja zdarzeń. W środowisku OT błędna decyzja algorytmu może mieć bezpośredni wpływ na proces fizyczny.